▲제리 카플란의 책 <인간은 필요없다> 표지 사진.

한스미디어

<인간은 필요없다>의 저자 제리 카플란은 인공지능에 관한 걱정이 곧 현실이 될 것이라고 주장한다. 스탠포드대학 졸업생이 벤처 자금을 지원받아 창업한 '블루리버 테크놀로지스'의 '잡초 뽑는 로봇' 등을 예로 들면서 말이다.

미국에서 최근 수확된 과일을 포장하는 로봇도 개발 중이며, '록시'와 '로키'라는 이름으로 성매매업을 위한 인공지능 섹스 로봇까지 만들어지고 있다. 자율주행 차량은 수많은 운전기사의 일자리를 대체할 것이고, 이는 우리가 알다시피 오늘날 실험이 진행 중이다.

본문은 "건너편 빌딩에 가서 커피를 테이크아웃 해오는 로봇까지 이미 실험에 성공했다"라면서 당신의 일자리가 안전하지 않다고 경고한다. 물건을 진열하는 매장 관리와 창고 정리, 심지어 법조계 일자리까지 최근 연구 중인 인공지능이 조만간 넘볼 것이라는 얘기다.

일자리 문제를 넘어 인공지능이 인간의 생명을 결정해야 하는 순간은 어떨까. 자율주행 차량에 내장된 인공지능이 '갑자기 도로에 뛰어든 아이'와 '뒷좌석에 탑승한 아이' 중 누구를 희생할지 결정하는 상황이 온다면? 저자 카플란은 "위험은 인공지능이 공정성에 무지하다는 점에 있다"라면서 우려한다.

인공지능이 인간을 '적'으로 인식하지 않더라도 '제거 대상'에 놓을 수 있다는 예상도 나온다. 인공지능 시스템의 자율성을 높일수록 변수가 많아지기 때문이다. 만약 로봇에 별다른 지시 없이 '관람 경쟁이 치열한 공연 티켓을 예매하라'고 부탁했을 때, 로봇이 잠재적 경쟁 대상을 모두 없애버리는 방식을 택한다면? 체스 등 특정 경기에 참가해서 '우승하라'는 지시에 상대 선수들이 경기장에 오지 못하도록 온라인에서 항공편을 모두 막아버린다면?

이처럼 본문에 등장하는 예는 소름 끼치지만, 저자는 이런 걱정이 그저 이론 수준의 토론이 아니라 이미 자율주행 차량 등의 개발에서 실제 적용 단계로 논의된다고 덧붙인다. 그는 '사례 기반 추론'을 통한 도덕규범 커리큘럼이 인공지능 연구에서 중요한 부분을 차지해야 한다고도 주장한다. '컴퓨터 윤리'라는 신생 연구 분야에서 '인공 도덕적 행위자' 개념을 창조하려는 시도가 이어진다는 뜻이다.

인공지능이 '프로메테우스의 저주'가 되지 않으려면 과거 컴퓨터 학자 에츠허르 데이크스트라는 "기계가 생각을 할 수 있느냐고 묻는 것은 잠수함이 항해를 할 수 있느냐고 묻는 것과 마찬가지"라고 말했다. 이런 발상이 변한 첫 계기는 수학자 존 매카시에 의해 '인공지능'이라는 단어가 처음 생긴 1956년이었다. 당시 IBM은 그들이 만든 '인공지능 연구팀을 해체하겠다'는 다소 엉뚱한 결정을 내린다.

당시 '컴퓨터가 내 일자리를 위협할지 모른다'고 생각한 잠재 고객을 안심하게 하려는 대책이었다. 인공지능을 향한 부정적 인식이 최신 데이터 처리 장비를 판매에 영향을 줄 것이라 판단한 당시 IBM 측은 "컴퓨터는 프로그램된 기능만 수행한다"라고 애써 해명해야 할 정도였다.

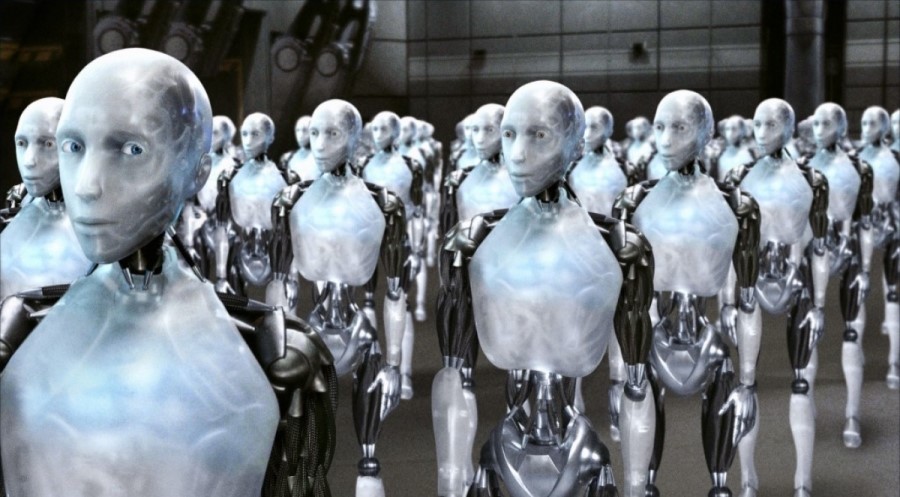

▲영화 <아이 로봇>의 한 장면

이십세기폭스코리아(주)

70년이 흐른 2016년, 알파고가 바둑에서 인간을 넘어선 시점에 이런 걱정이 다시 재현되고 있다. <인간은 필요없다>의 저자 제리 카플란은 대안으로 '인공지능 윤리' 개발과 '직업 대출' 정책을 주장한다. '직업 대출'은 대학을 취업 전문기관의 개념으로 바꾸자는 주장인데, 내용을 살펴보면 자칫 '인턴십'보다 불안정한 고용 모델의 광범위한 정착이 아닐까 우려되는 면도 있다.

하지만 법정보센터 교수인 저자가 제안하는 '인공지능 윤리'는 분명 필요한 사항이 아닐까. SF소설의 거장 아시모프가 그의 소설에서 제시한 '로봇 3원칙'을 현실에서 적용해야 할지도 모른다. 이 원칙은 영화 <아이 로봇>의 모티브가 되기도 했다.

"제1원칙, 로봇은 인간에게 위해를 끼쳐서는 안 되며, 위험에 처한 인간을 방관해서는 안 된다. 제2원칙, 로봇은 인간의 명령에 반드시 복종해야 하지만, 제1원칙에 위배되는 경우에는 예외다. 제3원칙, 로봇은 자기 자신을 보호해야만 한다. 그러나 1원칙과 2원칙에 위배되는 경우는 예외다."아직 인공지능을 현실에 직접 접목하기에 앞서, 고려해야 할 문제가 꽤 많아 보인다. 지난 2010년 5월, 미국 주식 시장에서 알고리즘 로봇의 잘못된 계산으로 약 1조 달러(약 1191조 원)가 5분 만에 증발한 '플래시 크래시'(Flash crash, 갑작스러운 붕괴) 사건도 있었다.

기술의 진보가 반드시 긍정적인 사례만 낳지 않는다는 것은 이미 맨해튼 프로젝트의 사례로도 역사에 남아있다. 숨 가쁘게 진행되는 연구에 앞서 잠시 인공지능이 인류를 노동에서 해방할 '구원'이 될는지, 아니면 지나치게 빠른 발전 때문에 골치 아픈 문제가 될지 진지하게 고민해야 하진 않을까.

영화 <프로메테우스>처럼 그저 '할 수 있으니까' 당장 만들기엔 인공지능이 인류의 삶에 가져올 변화가 꽤 거대할 것 같다. 우리 손에 든 것이 앞날을 밝혀줄 '등불'인지 혹은 프로메테우스의 불이 가져온 '판도라의 상자'인지 돌아봐야 할 시기인지도 모른다.

인간은 필요 없다 - 인공지능 시대의 부와 노동의 미래

제리 카플란 지음, 신동숙 옮김,

한즈미디어(한스미디어), 2016

저작권자(c) 오마이뉴스(시민기자), 무단 전재 및 재배포 금지

오탈자 신고

오마이뉴스 전국부 기자입니다. 조용한 걸 좋아해요.

기사를 스크랩했습니다.

스크랩 페이지로 이동 하시겠습니까?

연도별 콘텐츠 보기